إعداد: مصطفى الزعبي

صمم باحثون من جامعة ميشيغان الأداة، التي تسمى«WorldScribe»، برنامج مدعوم بالذكاء الاصطناعي يروي البيئة المحيطة للأشخاص الذين يعانون ضعف البصر

ويصبح عالم الألوان والملمس في متناول الأشخاص المكفوفين أو ضعاف البصر قريباً، وذلك من خلال البرنامج الجديد الذي يروي ما تسجله الكاميرا.

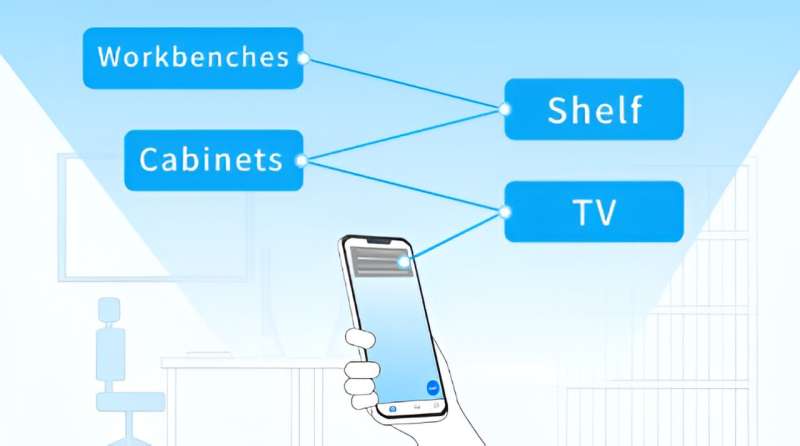

تستخدم الأداة نماذج لغة الذكاء الاصطناعي التوليدي (GenAI) لتفسير صور الكاميرا وإنتاج أوصاف نصية وصوتية في الوقت الفعلي لمساعدة المستخدمين على الوعي بمحيطهم بشكل أسرع. ويمكنها ضبط مستوى التفاصيل بناءً على أوامر المستخدم أو طول الوقت الذي يظل فيه الكائن في إطار الكاميرا، ويتكيف مستوى الصوت تلقائياً مع البيئات الصاخبة مثل الغرف المزدحمة والشوارع المزدحمة والموسيقى الصاخبة.

وقال سام راو، الذي ولد أعمى وشارك في الدراسة التجريبية التي أجرتها مؤسسة وورلد سكرايب: «بالنسبة لنا نحن المكفوفين، فإن هذا قد يحدث ثورة حقيقية في الطرق التي نتعامل بها مع العالم في حياتنا اليومية».

خلال الدراسة التجريبية، ارتدى راو سماعة رأس مزودة بهاتف ذكي وتجول في مختبر الأبحاث، نقلت كاميرا الهاتف الصور لاسلكياً إلى خادم أنتج على الفور نصاً وأوصافاً صوتية للأشياء الموجودة في إطار الكاميرا: كمبيوتر محمول على مكتب، وكومة من الأوراق، وجهاز تلفزيون ولوحات مثبتة على الحائط القريب.

كانت الأوصاف تتغير باستمرار لتتناسب مع ما كان في مجال رؤية الكاميرا، مع إعطاء الأولوية للأشياء الأقرب إلى راو، كانت نظرة خاطفة سريعة على المكتب تنتج وصفاً بسيطاً من كلمة واحدة، لكن الفحص الأطول أسفر عن معلومات حول المجلدات والأوراق المرتبة في الأعلى.

أداة ذكية تنير الطريق لضعاف البصر

11 أكتوبر 2024 19:58 مساء

|

آخر تحديث:

11 أكتوبر 19:58 2024

شارك