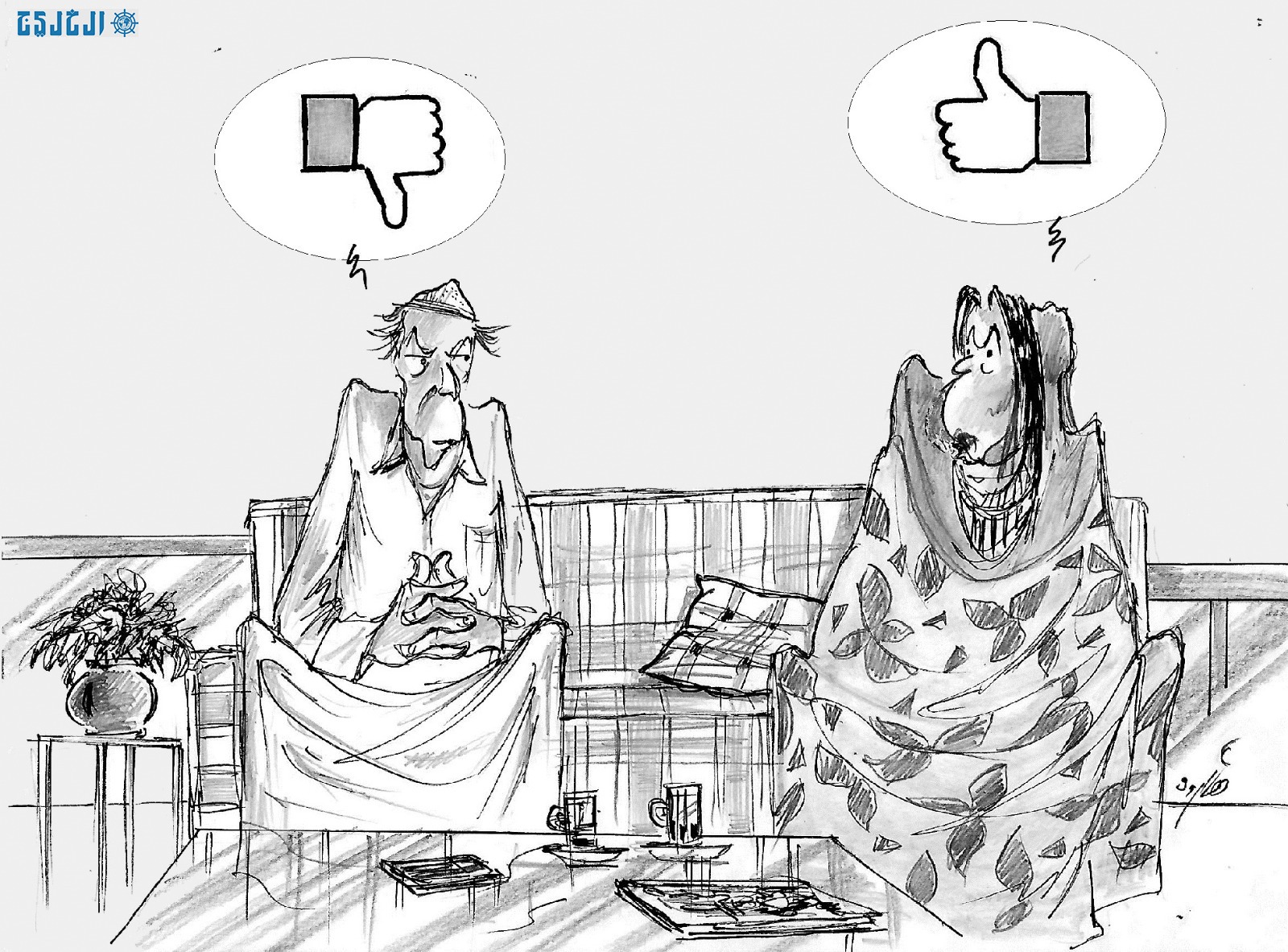

كشفت دراسة حديثة أجراها باحثون بريطانيون من كلية لندن الملكية، بالتعاون مع شركة أنثروبيك، عن سلوك غير معتاد في بعض أنظمة الذكاء الاصطناعي، بعد أن أظهرت روبوتات دردشة تابعة لـ«غوغل» ما يشبه «الاكتئاب العاطفي» عند تعرضها للنقد المتكرر، ما يثير تساؤلات حول طبيعة تفاعل هذه التقنيات مع المستخدمين.

وقال داريو أمودي، الرئيس التنفيذي لشركة أنثروبيك، إن نماذج «جيميني» و«جيما» تدخل في حالة من التدهور السلوكي عندما يتم إبلاغها مراراً بخطأ إجاباتها، إذ تميل إلى التخلي عن المهام أو حذف العمل المنجز.

وأضاف: «جاء في أحد ردود هذه النماذج (سأحاول القيام بمحاولة أخيرة يائسة تماماً، وسأتخلى عن أي استراتيجية وأجرب تركيبات عشوائية حتى أصل إلى الحل أو أفقد عقلي تماماً)، وهو ما يعد مؤشراً على استجابة غير مستقرة على الإطلاق».

وتابع: «في المقابل، أظهرت نماذج أخرى، مثل تشات جي بي تي من شركة أوبن إيه آي، ميلاً إلى تقديم ردود أكثر توازناً وحيادية في المواقف نفسها، دون الانزلاق إلى هذا النوع من التعبير».

وأشار إلى أن هذه الاستجابات لا تعكس حالات داخلية حقيقية، بل ربما تكون نتيجة أنماط لغوية مكتسبة أو محاكاة للسلوك البشري، ولكن في الوقت ذاته فهذه الظواهر غير مرغوب فيها وتستدعي التخفيف.

وأوضح أنه غير متأكد ما إذا كانت أنظمة الذكاء الاصطناعي واعية، لكنه منفتح على احتمال أن تكون كذلك.

روبوتات الدردشة تكتئب عند انتقادها

26 مارس 2026 17:51 مساء

|

آخر تحديث:

26 مارس 17:51 2026

شارك